Indice dei contenuti

L’analisi di Data Masters svela il paradosso del mercato: non è l’automazione a minacciare i programmatori, ma la carenza di esperti in sistemi agentici

Il risultato? Stipendi in crescita del 15% per chi sa governare l’algoritmo

La narrativa degli ultimi mesi sembrava già scritta: modelli sempre più potenti, software capaci di programmarsi da soli e grandi big tech che annunciano licenziamenti in nome dell’automazione. Ma dietro il sipario dell’efficienza algoritmica, i dati del mercato del lavoro raccontano una storia diversa. E molto più complessa.

Secondo un’analisi condotta da Data Masters https://datamasters.it/ ulle competenze digitali emergenti, non siamo di fronte a un declino, ma a una vera e propria fiammata della domanda: i profili specializzati in Agenti AI sono cresciuti del 38%, mentre quelli relativi ai Large Language Models (LLM) hanno segnato un balzo del 45%.

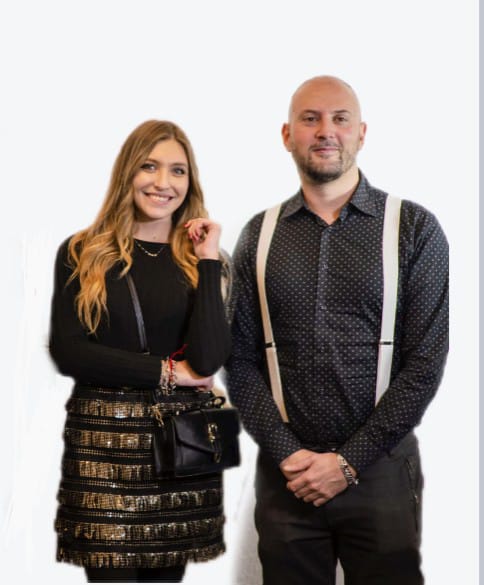

Il risultato? Un paradosso salariale. Gli sviluppatori che padroneggiano l’AI generativa e le architetture avanzate ottengono oggi premi in busta paga fino al 15% superiori rispetto ai profili tradizionali. “Si è diffusa l’idea che l’intelligenza artificiale sostituirà gli sviluppatori” – spiega Luigi Congedo, co-founder di Data Masters. “I dati mostrano invece l’opposto: le aziende hanno una fame disperata di ingegneri capaci di governare sistemi AI complessi. Il problema oggi non è l’abbondanza di automazione, ma la scarsità di chi sa farla funzionare davvero.”

Il paradosso del “Painted Door”: quando l’IA promette ma non apre porte

Alla base di questo fenomeno c’è anche la distanza tra l’hype che circonda l’AI generativa e la complessità della sua applicazione reale. Negli ultimi mesi si è diffusa l’idea del cosiddetto vibe coding: sviluppare applicazioni semplicemente descrivendo ciò che si vuole ottenere a un modello di intelligenza artificiale.

Nella pratica, però, molte organizzazioni stanno scoprendo i limiti di questo approccio. L’AI produce spesso risultati che sembrano completi e funzionanti, ma che non reggono il passaggio alla produzione: prototipi con dati simulati al posto di database reali, integrazioni mancanti o vulnerabilità di sicurezza.

È quello che alcuni esperti definiscono il “Painted Door Problem”: una porta perfettamente dipinta su un muro che sembra reale finché non si prova ad aprirla.

“Molti prototipi generati con l’AI sembrano pronti” – aggiunge Vincenzo Maritati, co – founder di Data Masters. “Ma quando provi a usarli scopri che è come aprire una porta dipinta su un muro: sembra reale, ma non funziona. È proprio qui che servono competenze senior”.

L’era dei sistemi agentici

In questo scenario, il valore degli sviluppatori più esperti non diminuisce ma cresce. Integrare sistemi di intelligenza artificiale nei processi aziendali richiede competenze architetturali avanzate, capacità di validazione del codice e esperienza nella gestione di sistemi complessi.

Il vero cambiamento che si sta profilando, infatti, non riguarda soltanto la generazione automatica di codice, ma l’arrivo di sistemi agentici autonomi: software capaci non solo di scrivere codice, ma di testarlo, correggerlo, distribuirlo e gestirlo nel tempo.

Un’evoluzione che promette di trasformare profondamente il modo in cui si sviluppa software, ma che allo stesso tempo rende ancora più centrale il ruolo delle competenze senior.

“Il vero salto non sarà l’AI che scrive codice” – afferma Congedo – “Sarà l’AI che costruisce, testa e distribuisce software in autonomia. In quel mondo il ruolo degli sviluppatori non sparirà: diventerà ancora più strategico”.

3 pilastri per un’integrazione reale dell’AI in azienda

Secondo Data Masters, per sfruttare davvero il potenziale dell’intelligenza artificiale le aziende devono affrontare la transizione con un approccio strategico.

Investire sulle competenze senior. Gli strumenti di AI generativa stanno abbassando la barriera d’ingresso allo sviluppo software, ma l’integrazione nei sistemi aziendali richiede competenze avanzate in architettura, integrazione e validazione del codice.

Integrare sicurezza e verifiche nei workflow AI. L’adozione di modelli linguistici introduce nuove superfici di rischio, dalle vulnerabilità nei prompt alle possibili manipolazioni dei modelli. Costruire pipeline di sviluppo con test e controlli automatici diventa quindi essenziale.

Prepararsi all’arrivo degli agenti autonomi. La prossima evoluzione dell’AI riguarda sistemi capaci di pianificare, eseguire e verificare attività complesse in autonomia. Per le aziende sarà fondamentale sviluppare competenze su orchestrazione degli agenti e supervisione tecnica.

“Il vero rischio per le aziende oggi non è restare senza AI, ma adottarla senza le competenze necessarie. La differenza tra hype e valore reale si gioca tutta nella capacità di costruire sistemi affidabili.” – conclude Vincenzo Maritati.